„Każdego dnia ludzie spotykają się na Facebooku, aby dzielić się nowinami, spojrzeć na świat oczami innych lub sprawdzić, jak toczą się bliskie im sprawy i co słychać u znajomych” – tak zaczyna się opis Standardów społeczności Facebooka. Niektórzy z tych ludzi udostępniają zdjęcia z wakacji w Tajlandii, inni streamują na żywo swoje samobójstwa, publikują i udostępniają twardą pornografię z udziałem dzieci, terrorystyczne filmy propagandowe, czy nawołują do ludobójstwa w Mjanmie.

Ekran monitora oświetla twarz moderatorki w boksie na wygaszonym open space w biurowcu w Manili. Dziewczyna sprawdza strumień zdjęć, filmów i postów pod kątem zgodności z regulaminem platformy. Klika: „Zignoruj”, czyli następne zdjęcie. „Usuń” – treść narusza warunki korzystania z platformy. Zignoruj albo usuń – ten binarny wybór niektórzy z moderatorów muszą podjąć 25 tysięcy razy dziennie. Mogą się pomylić trzy razy. Zignoruj. Zignoruj. Usuń.

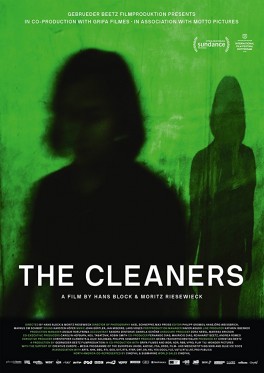

Dokument „Czyściciele internetu” Moritza Riesewiecka i Hansa Blocka, pokazywany na Millennium Docs Against Gravity, oddaje głos – niewidzialnym, zatrudnionym przez podwykonawców – moderatorom z Filipin, którzy usuwają nielegalne treści na Facebooku, Google’u czy Twitterze. To osadza się w ich głowach, jest żrące i toksyczne.

„Czysty” internet oglądamy dzisiaj między innymi dzięki taniej, cyfrowej sile roboczej z Filipin czy Indii. Tysiące anonimowych moderatorów sprząta media społecznościowe z najbardziej toksycznych treści. Niskopłatni pracownicy z krajów rozwijających się są naszą psychologiczną tarczą, biorą na siebie siłę uderzenia. Po pewnym czasie pracy moderatorzy pękają, psują się.

Dla wielu z nich ta praca na Filipinach oznacza przetrwanie. W jednej ze scen matka moderatora mówi, że jest dumna z syna, który wspomaga finansowo rodzinę. Nie ma pojęcia, na czym polega jego praca – wie tylko, że pracuje w biurze. Umowy o zachowaniu poufności zobowiązują moderatorów do nieujawniania, dla kogo pracują i co robią. Według występującej w filmie prof. Sarah T. Robert z UCLA, Facebook czy Google mogą legalnie twierdzić, że nie zatrudniają żadnych pracowników w Manili, bo korzystają z miejscowych firm – podwykonawców. Wypłaty nie pochodzą od Google’a ani Facebooka, ale od podmiotów trzecich.

Moderatorzy i moderatorki występujący w filmie na początku mówią z wdrukowanym poczuciem ważności i odpowiedzialności swojej pracy, niekiedy nawet dumy. Czują się policjantami social media, ochroniarzami użytkowników. Ten etos pracy ich impregnuje. Wiedzą, że „ktoś musi to robić” – ich rolą jest „sprzątanie” platformy, żeby była bezpieczna i zdrowa dla wszystkich. Pomagają ludziom, robią „coś dobrego”. Jeden z nich mówi: „Moderator musi być jak snajper. Naszym celem są użytkownicy, którzy łamią reguły aplikacji”. Inny moderator mówi, że w swojej pracy, dbając o bezpieczeństwo platformy, chce być taki jak prezydent Rodrigo Duterte, który dba o bezpieczeństwo Filipin i wypowiedział wojnę z narkotykami – zlecając egzekucje i samosądy na dilerach.

„Czyściciele internetu” („The Cleaners”), reż. Moritz Riesewieck, Hans Block / Festiwal Millennium Docs Against Gravity 2018Riesewieck i Block analizują, jak wykorzystywany jest historyczny i kulturowy kontekst Filipin jako byłej kolonii hiszpańskiej. Filipiny są żarliwie katolickim krajem. Wypowiedzi moderatorów są przeplatane ujęciami słynnych rytuałów corocznego krzyżowania ludzi w Wielki Piątek w Manili oraz samobiczowań. W tym sensie pobożni moderatorzy oczyszczając internet, oczyszczają nasz świat z grzechu. Szkodliwe filmy i obrazy, które muszą zobaczyć – tortury i perwersje, które wracają do nich później w snach, są rodzajem męczeństwa, umartwiania.

„Czyściciele internetu” („The Cleaners”), reż. Moritz Riesewieck, Hans Block / Festiwal Millennium Docs Against Gravity 2018Riesewieck i Block analizują, jak wykorzystywany jest historyczny i kulturowy kontekst Filipin jako byłej kolonii hiszpańskiej. Filipiny są żarliwie katolickim krajem. Wypowiedzi moderatorów są przeplatane ujęciami słynnych rytuałów corocznego krzyżowania ludzi w Wielki Piątek w Manili oraz samobiczowań. W tym sensie pobożni moderatorzy oczyszczając internet, oczyszczają nasz świat z grzechu. Szkodliwe filmy i obrazy, które muszą zobaczyć – tortury i perwersje, które wracają do nich później w snach, są rodzajem męczeństwa, umartwiania.

Nieprzypadkowo też Filipiny jako była amerykańska kolonia pasują do układanki. Moderatorzy muszą do pewnego stopnia rozumieć kontekst i niuanse treści – odróżniać pornografię, sztukę czy satyrę. Dzieląc część zachodnich wartości, mogą lepiej redukować je do „zignoruj” albo „usuń”. Autorzy dokumentu problematyzują to według tych wyborów. Pokazują, co się dzieje, kiedy moderatorzy cenzurują daną treść, np. usuwają obraz „Make America Great Again” Illmy Gore przedstawiający nagiego Donalda Trumpa z mały penisem albo zdjęcie więźnia torturowanego przez amerykańskiego żołnierza w Abu Ghraib (moderator myślał, że to żołnierz ISIS). Pokazują też treści, które moderatorzy zostawiają – hejt i dezinformację.

Funkcją moderatorów jest utrzymanie iluzji, że Facebook i Google są neutralnymi platformami. Mają usuwać najgroźniejszy kontent, który sprawia, że politycy chcą regulować te firmy, użytkownicy odchodzą i akcje lecą w dół. Ale sama architektura platform jest tak zaprojektowana, że im bardziej ekstremalne i skandaliczne treści – w tym hejt i fake newsy – tym więcej lajków, udostępnień i komentarzy. Podstawowym celem Facebooka i innych platform internetowych jest przyciągnąć jak najwięcej naszej uwagi i jak najdłużej ją utrzymać, bo obok postów są wyświetlane reklamy. Im bardziej szalona teoria spiskowa, im gorszy patostream – tym lepszy viral, tym więcej ruchu użytkowników. W interesie ekonomicznym platformy jest, żeby to się jak najszerzej niosło niż żebyśmy tego w ogóle nie widzieli. Sam komercyjny mechanizm wzmacnia przerażające treści, wydobywa z ludzi ich najgorsze cechy.

Facebook przez lata korzystał z cyrkulacji tych informacji – z tego, że feedy były pełne rasizmu i propagandy. Zarabiał też na mowie nienawiści wobec eksterminowanej przez buddystów mniejszości muzułmańskiej Rohingja w Mjanmie, bo zbierała najwięcej lajków. Dla mieszkańców Mjanmy Facebook to podstawowe źródło informacji – to praktycznie internet, bo większość mieszkańców nie korzysta z innych platform. Posty nawołujące do eksterminacji i gwałtów na Rohingja miały ogromną popularność, najlepsze zasięgi, tysiące udostępnień. Ponad milion mieszkańców zostało zmuszonych do ucieczki do Bangladeszu.

Facebook i Google rozwijają też sztuczną inteligencję do wykrywania i usuwania nielegalnych treści, czyli zautomatyzowania pracy moderatorów. Na pewno chcą wyjść poza retroaktywne usuwanie kontentu – moderatorzy sprawdzają tylko to, co zostało zgłoszone – żeby algorytmy przeczesywały całą platformę. Ale też muszą wiedzieć, że praca moderatorów zacznie przyciągać złą prasę, powstanie więcej dokumentów w rodzaju „Czyścicieli internetu”. W filmie jeden z moderatorów opowiada o swoim koledze w pracy, specjalizującym się w usuwaniu samookaleczeń, który się powiesił. Podwykonawca miał zatuszować sprawę.

W „Czyścicielach” autorzy nie poruszają kwestii automatyzacji pracy moderatorów, ale każda decyzja „ignoruj” albo „usuń” to cegiełka do tony danych statycznych do uczenia maszynowego AI. Im więcej danych, tym mechanizm będzie lepszy, tym większa skala porównania „niewłaściwych” treści i lepsze rozumienie niuansów i kontekstu treści – czy to będzie przemoc, rasizm czy posty Krystyny Pawłowicz. Niskopłatna i traumatyczna praca moderatorów zostanie zlewarowana do powstania tych algorytmów. Ich celem będzie przede wszystkim, żeby platformy internetowe dalej – bez tarcia – generowały zyski. Moderatorzy zapłacą za to swoją psychiką. Możliwe, że te algorytmy automatycznie usuwając niewłaściwe treści na wielką skalę, jednocześnie wykorzenią z niego krytyczne myślenie, będą omylne, ale jeśli jakaś praca powinna zostać zautomatyzowana – to właśnie moderatorów. Maszyny powinny wyzwalać przede wszystkim od prac niebezpiecznych, ogłupiających i upokarzających.

Temat robotyzacji pracy podejmują reżyserzy Sean Blacknell i Wayne Walsh w pierwszej części dokumentu – również pokazywanego na Millennium Docs Against Gravity – „The Future of Work and Death”. Wypowiadający się w filmie naukowcy, przedsiębiorcy i futuryści przewidują, jak postęp technologiczny w najbliższych 30 latach może sprawić, że wiele zawodów stanie się zbędnych, zastąpionych przez maszyny i zaawansowane algorytmy, oraz jakie mogą być tego konsekwencje społeczno-polityczne.

„Przyszłość człowieka pracy” („The Future of Work and Death”), reż. Sean Blacknell, Wayne Walsh / Festiwal Millennium Docs Against Gravity 2018Wśród występujących naukowców i technooptymistów, najbardziej zaniepokojony robotyzacją okazuje się, paradoksalnie, Martin Ford, przedsiębiorca z Doliny Krzemowej i autor książki „Świt robotów. Czy sztuczna inteligencja pozbawi nas pracy?”, nagrodzonej przez „Financial Times” i firmę McKinsey, giganta doradztwa strategicznego, czyli niespecjalnie wrażliwe społecznie ośrodki.

„Przyszłość człowieka pracy” („The Future of Work and Death”), reż. Sean Blacknell, Wayne Walsh / Festiwal Millennium Docs Against Gravity 2018Wśród występujących naukowców i technooptymistów, najbardziej zaniepokojony robotyzacją okazuje się, paradoksalnie, Martin Ford, przedsiębiorca z Doliny Krzemowej i autor książki „Świt robotów. Czy sztuczna inteligencja pozbawi nas pracy?”, nagrodzonej przez „Financial Times” i firmę McKinsey, giganta doradztwa strategicznego, czyli niespecjalnie wrażliwe społecznie ośrodki.

Martin Ford twierdzi, że współczesna rewolucja technologiczna jest inna niż rewolucja przemysłowa, która dotykała tylko określonych sektorów gospodarki, przede wszystkim rolnictwa. Automatyzacja zniszczy dużo więcej zawodów rutynowych i powtarzalnych – nie tylko fizycznych, ale też intelektualnych – bo jest rozwijana we wszystkich gałęziach ekonomii. Już dzisiaj coraz większa część pracy chirurgów, pilotów samolotów, prawników czy bankierów jest wykonywana przez maszyny. Branża technologiczna z kolei – poza pracą inżynierów i programistów dostępną dla wąskiej grupy ludzi (i też stopniowo automatyzowanej) – tworzy dużo nowych miejsc pracy, ale niskopłatnych, niestabilnych i szkodliwych, jak praca moderatorów Facebooka na Filipinach.

Robotyzacja tym samym pogłębia narastające od kilku dekad nierówności społeczne. Według Forda tylko polityczna interwencja: nałożenie nowych podatków, wprowadzenie dochodu gwarantowanego czy sprawiedliwa dystrybucja nowych technologii – w tym w krajach rozwijających – może zapobiec katastrofie.

Dokument „The Future of Work and Death” pomija jednak kwestię, jak zaawansowane technologie zmieniają pracę człowieka, zanim zostanie w pełni zastąpiona przez roboty. Maszyny obniżają próg wejścia i wymaganych kwalifikacji do określonych zawodów, tym samym obniżają pensje i sprawiają, że pracodawcy mogą swobodnie wymieniać pracowników – coraz częściej imigrantów – lub outsourcować ją. Pracowników fast foodów nie trzeba długo szkolić. Wykonują powtarzalne, automatyczne czynności na taśmociągu. Na podobnej zasadzie wymagająca znajomości miasta praca taksówkarzy zostaje zastąpiona przez Ubera. Technologia na razie pozwala redukować ludzką inteligencję do prostych wyborów w rodzaju „ignoruj” albo „usuń”, które muszą podejmować moderatorzy.

Film nie rozróżnia też specjalnie, jaki wpływ może mieć automatyzacja na kraje rozwijające się. Według raportu Konferencji Narodów Zjednoczonych ds. Handlu i Rozwoju, w wyniku automatyzacji pracy w krajach rozwijających się zniknie dwie trzecie miejsc pracy. Jeśli w Afganistanie nie zabiją cię drony wojskowe, masz dużą szansę, że ich nieuzbrojone wersje zabiorą twoją pracę w rolnictwie.

Robotyzacja w tym sensie jest symetryczna z nastrojami antyimigranckimi w zachodnich społeczeństwach. Jej efektem ma być „odzyskanie” miejsc pracy outsourcowanych do fabryk w Azji. Pracę szwaczek w Pakistanie, Indonezji czy na Filipinach mogą „odzyskać” drukarki 3D. Tanie usługi pracowników call center w Bengaluru, w Indiach, „odzyskają” algorytmy z syntezatorami mowy. Tym pracownikom nie grozi na razie bezrobocie – zawsze mogą wypalać elektrośmieci, wdychając toksyczne opary, odzyskując z płyt głównych i smartfonów złoto, srebro i platynę.

Druga, mniej ciekawa część „The Future of Work and Death” dotyczy innowacji w medycynie, biotechnologii i genetyce, które mogą sprawić, że przezwyciężymy śmierć. To znaczy nie my, ale najbogatsi – ale tego występujący w filmie transhumaniści nie mówią. Czy jedni z nas przez tysiące lat będą moderować Facebooka, a inni spokojnie kontemplować, jak gasną gwiazdy? W rojeniach o nieśmiertelności nie ma obawy, że podzielimy się na różne biologiczne kasty. Słowa Keynsa: „w długim okresie wszyscy będziemy martwi” – będą dotyczyć tylko biednej większości.

Tekst dostępny na licencji Creative Commons BY-NC-ND 3.0 PL (Uznanie autorstwa-Użycie niekomercyjne-Bez utworów zależnych).