25 września 1985 roku Jordan i David Mechner otrzymali paczkę z kamerą, która – zapisał w swoim dzienniku pierwszy z braci – okazała się tyleż „fantastycznym”, co „przerażającym” (bo drogim!) urządzeniem. Kilka tygodni później Jordan nagrał na parkingu pod redakcją nowojorskiego „Reader’s Digest” Davida, którego chód, bieg i skoki miały stać się zestawem ruchów jednego z bohaterów zbiorowej wyobraźni.

Na początku wydawało się, że nagranie okaże się bezużyteczne – w wielu ujęciach sceneria zlewała się bowiem z ubraniem kaskadera. Jednak starszy z braci nie załamywał rąk. Pokolorował tła na czarno, a sylwetkę Davida na biało i zanotował: „Nadal uważam, że to może działać. Postać będzie malutka, niechlujnie wykonana i pewnie gówniana... ale wierzę, że sekwencyjne wyświetlanie w szybkości 15 klatek na sekundę stworzy iluzję życia bardziej niesamowitą niż cokolwiek, co pojawiło się dotąd na ekranie komputera Apple II”.

Miał rację. Jego książę poruszał się z gracją, jakiej mogliby mu pozazdrościć Mario, Samus, Mega Man i reszta platformówkowych tuzów epoki.

Prowadzenie wspomnianego dziennika – opublikowanego dwie dekady po premierze gry – Jordan Mechner rozpoczyna jako pogubiony 21-latek, który ma już co prawda na koncie debiut w gamedevie (wydanego w 1984 roku „Karatekę”), ale swoją przyszłość wiąże raczej z kinem. I faktycznie, da się wyczuć w estetyce „Prince of Persia” (1989) inspiracje twórczością Disneya (vide tła z pałacu wezyra, którym blisko do plansz z „Alladyna”). Co jednak ważniejsze: animacja gry zdradza fascynację Mechnera motion capture: przechwytywaniem rzeczywistego ruchu i późniejszym przenoszeniem go na monitory.

W latach 90. „Książę Persji” dopiero odkrywał mocap dla gamedevu, natomiast Hollywood bawiło się nim od dawna. Rzeczywistych korzeni technologii należy jednak upatrywać nie tyle w studiach filmowych, ile na wyścigach koni.

Latający koń

W parku okalającym siedzibę Lucasfilm w San Francisco rzeźba mistrza fotografii Eadwearda Muybridge’a stoi nieopodal pomników mistrza telewizji Philo T. Farnswortha i mistrza Jedi Yody. Posągowy Muybridge nachyla się nad stworzonym przez siebie zoopraksiskopem, pierwowzorem projektora filmowego. Tuż pod nim w brązie odlano klatki z biegnącym koniem.

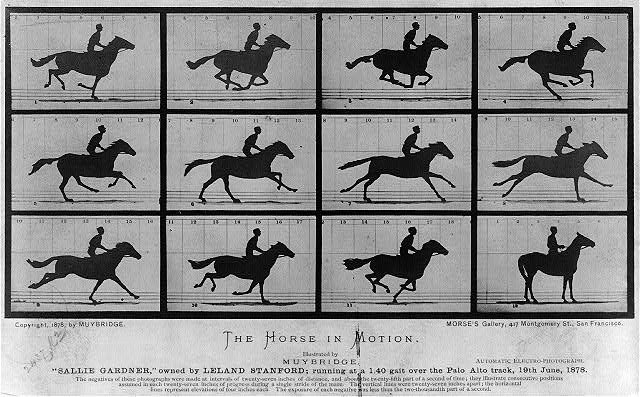

Za mit założycielski mocapu uznaje się zakład fotografa z kalifornijskim senatorem Lelandem Stanfordem. Anegdota głosi, że w latach 70. XIX wieku ten wytrawny koniarz zaoferował Muybridge’owi 25 tys. dolarów. W zamian chciał dowodu, że galopujący wierzchowiec choć na chwilę odrywa od podłoża wszystkie kopyta. Wśród bywalców torów przeważał wówczas pogląd, zgodnie z którym zwierzę cały czas musi opierać się na ziemi choć jedną kończyną, czemu jednak republikański polityk uparcie nie dawał wiary.

Niewidoczny gołym okiem niuans stał się oczywisty dzięki zastosowaniu przez Muybridge’a elektronicznej migawki własnego projektu. Ostatecznie sprezentował on zleceniodawcy serię 12 zdjęć biegnącej klaczy, a na niektórych fotografiach faktycznie unosiła się ona ponad ziemią.

Sprezentował, dodajmy, nie bez problemów. Mniej poważny z nich dotyczył potrzeby skrócenia czasu naświetlania klatek. Istotniejszy: zamordowania przez Muybridge’a kochanka własnej żony, którego uważał zresztą za ojca wychowywanego przez siebie dziecka. Zatrudniony przez senatora Stanforda prawnik zdołał jednak przekonać ławę przysięgłych, że czyn fotografa kwalifikuje się jako usprawiedliwione zabójstwo.

Fletcher, Disney, Szyc

Wiek XX studia filmowe powitały, bawiąc się animacją rotoskopową (ręcznym – klatka po klatce – odrysowywaniem ruchu aktorów i nanoszeniem na niego kreskówkowych postaci). Choć światu przedstawił ją urodzony i wychowany w Polsce Max Fletcher, na pozycję lidera technologii wysforował się wkrótce Walt Disney, wykorzystując w 1939 roku rotoskopię do wprawienia w ruch „Królewny Śnieżki i siedmiu krasnoludków”. Na przełomie lat 70. i 80. karierę zrobił w branży animatorów Scanimate, komputer Lee Harisona III, który był w stanie generować animacje w czasie rzeczywistym w dwukrotnie wyższej liczbie klatek, niż osiągały wówczas filmy aktorskie. W analogicznym okresie podwoje otwarło Oxford Metrics, z którego w linii prostej wywodzi się Vicon, technologiczny start-up specjalizujący się w przechwytywaniu ruchu. U zarania jego czujniki i kamery wykorzystywano do celów medycznych lub naukowych (np. monitorowania kondycji sportowców), ale szybko zrobiły one wielką karierę także w rozrywce.

Ze zdobyczy epoki skorzystał Robert Abel, z pompą prezentując Amerykanom mariaż mocapu i komputerowo generowanej animacji podczas finału Super Bowl. Jego spot „Brilliance”, w którym androidka stara się zmienić wizerunek jedzenia w puszkach, obejrzało w 1985 roku ponad 85 milionów kibiców i kibicek.

Na przełomie mileniów mocap szturmem zdobył multipleksy. W 1999 roku George Lucas przechwytywał ruch w „Gwiezdnych wojnach. Mrocznym widmie” (rezultatem była niezbyt ciepło przyjęta postać Jar-Jara). W 2001 roku odbyły się premiery „Final Fantasy: The Spirits Within” (pierwszego filmu, w którym motoryka postaci opierała się wyłącznie o motion capture) oraz „Władcy pierścieni. Drużyny pierścienia” Petera Jacksona (z Andym Serkiesem w roli mocapowego Golluma). W 2004 roku Robert Zemeckis nakręcił „Ekspres polarny”, w 2007 roku James Cameron podbił stawkę „Avatarem”, a w 2011 Steven Spielberg swoimi „Przygodami Tin-Tina” powiedział: „Sprawdzam”.

Co zrozumiałe, do Polski moda przybyła później. W dodatku – tylnymi drzwiami, bo dzięki gamedevowi, nie branży filmowej. Za jej pioniera należy uznać Borysa Szyca, który wcielił się w utopca na okoliczność pierwszego ze zwiastunów „Wiedźmina” (2007) CD Projekt Red. Sesja odbyła się w podziemiach jednego z warszawskich szpitali, który jako jedyny był wówczas w posiadaniu bardzo prostego systemu motion capture, używanego do celów ortopedycznych.

Wiedźmiński dźwig

„Trochę się boję, że jak opublikujesz tekst o motion capture, to przeczyta nas ktoś decyzyjny i w ramach budżetówki powstaną kolejne niedziałające studia mocapowe” – wzdycha dr inż. Jakub Marszałkowski z Game Industry Conference i Politechniki Poznańskiej. „A to źle?” – pytam. „Najgorzej! Instytucje publiczne już nakupowały parę lat temu różnego takiego sprzętu (z myślą, że pozostanie im on po projekcie jako wartość dodana!), ale nie umiały go wykorzystać. A już tym bardziej komercjalizować. Bo taki sprzęt bez topowej kadry ma wartość złomu. Szacowałbym, że na każde województwo przypadają jedno–dwa martwe «studia mocapowe»”.

Problem w tym, że za tamtymi zakupami nie poszedł żaden program edukacyjny. To, że instytucje nabyły 10 lat temu sprzęt, nie znaczy współcześnie nic – leżące po magazynach kamery, czujniki i soft stanowią raczej archeologiczne znaleziska albo muzealne eksponaty. Dekadę temu motion capture było tańsze i dużo łatwiejsze w obsłudze, wówczas jednak branża kreatywna nie chciała się go uczyć. Smutną ofiarą takiego „nieuctwa” było choćby MMC Brainville, otwarte w 2015 roku nowosądeckie miasteczko multimedialne, którego budowa pochłonęła 140 mln zł. Spadek po nim – m.in. nowoczesne studium mocapowe – prywatny oferent odkupił w 2021 roku za dziesiątą część tej kwoty.

Głośnym echem odbiło się w branży ponadto zamknięcie krakowskiego SoInteractive i położonej nieopodal Krakowa Alvernii. W pionierskich czasach potrafiły one jednak realizować zlecenia, które i dziś imponują rozmachem. Na potrzeby intra do „Wiedźmina 2. Zabójców królów” na plan wjechał dźwig. Jego ramię uniosło makietę grającą pokład tonącego okrętu, z którego próbowali nie wypaść żołnierze króla Demawenda.

Mocapową burzę i napór z sukcesem przetrwało natomiast np. warszawskie Platige Image. Choć jego założyciele zaczynali od sprzedaży fluorescencyjnych lamp (nieco później zajmowali się realizacją teledysków Justyny Steczkowskiej), szybko wyczuli Zeitgeist. Ich artystyczny kolektyw rozsławił przede wszystkim Tomasz Bagiński, dziś ojciec chrzestny serialowego „Wiedźmina”, przed laty autor krótkich metraży, realizowanych z wykorzystaniem motion capture i cyfrowo generowanej grafiki. Jego inspirowana opowiadaniem Dukaja „Katedra” otrzymała w 2003 roku nominację do Oscara, z kolei za „Sztukę spadania” reżyser odebrał w 2005 roku statuetkę BAFTA.

Platige nie ma (jeszcze?) w Polsce monopolu, ale próg wejścia jest wysoki. Tymczasem samo motion capture stało się standardem w wielu branżach: animacji, filmach, grach wideo, a nawet w reklamach.

Indie Bagiński, gore Bachleda-Curuś

Mocap okazał się przepustką dla aktorów i kaskaderów, którym otworzył mniej uczęszczaną drogę do serc globalnej publiczności. Kostiumy z czujnikami oswoił w gamedevie duet Willem Dafoe i Elliot Page (obaj wystąpili w 2015 roku we francuskiej przygodówce „Beyond: Two Souls”). W Polsce przywdziewali je natomiast m.in. Marcin Dorociński i Weronika Rosati (horror „The Medium”) oraz Arkadiusz Jakubik (thriller „Observer”).

Wśród entuzjastów gier popularność zbudowała jednak przede wszystkim Alicja Bachleda-Curuś, która w cyklu „Wolfenstein” sportretowała Anię Olivę. Aktorka z sukcesem nauczyła Zachód polskich przekleństw, a drogę na amerykańskie, francuskie i niemieckie szpalty zapewniła sobie nieopatrznym ujawnieniem istnienia drugiej części shootera w wywiadzie dla „Dzień Dobry TVN”. Dodajmy, że choć nieco pokrzyżowała ona plany amerykańskim marketingowcom, to zagrała w sequelu scenę, którą smakosze gore ciepło wspominają do dziś.

Ale jak mocap właściwie działa? – zagaduję przez telefon Adriana Perdjona, współzałożyciela Bones Studio. „Wpadnij do nas, zobaczysz”.

Niepospolite ruszenie

Wzdłuż ulicy Strażackiej biegną tory kolejowe oraz ja. Spóźniony, szybko zostawiam za plecami hurtownię opakowań, hale magazynowo-produkcyjne i komin elektrociepłowni. Gdy trafiam pod wskazany przez Adriana adres, fasada budynku wydaje się naturalnie wrastać w przemysłowy krajobraz Rembertowa.

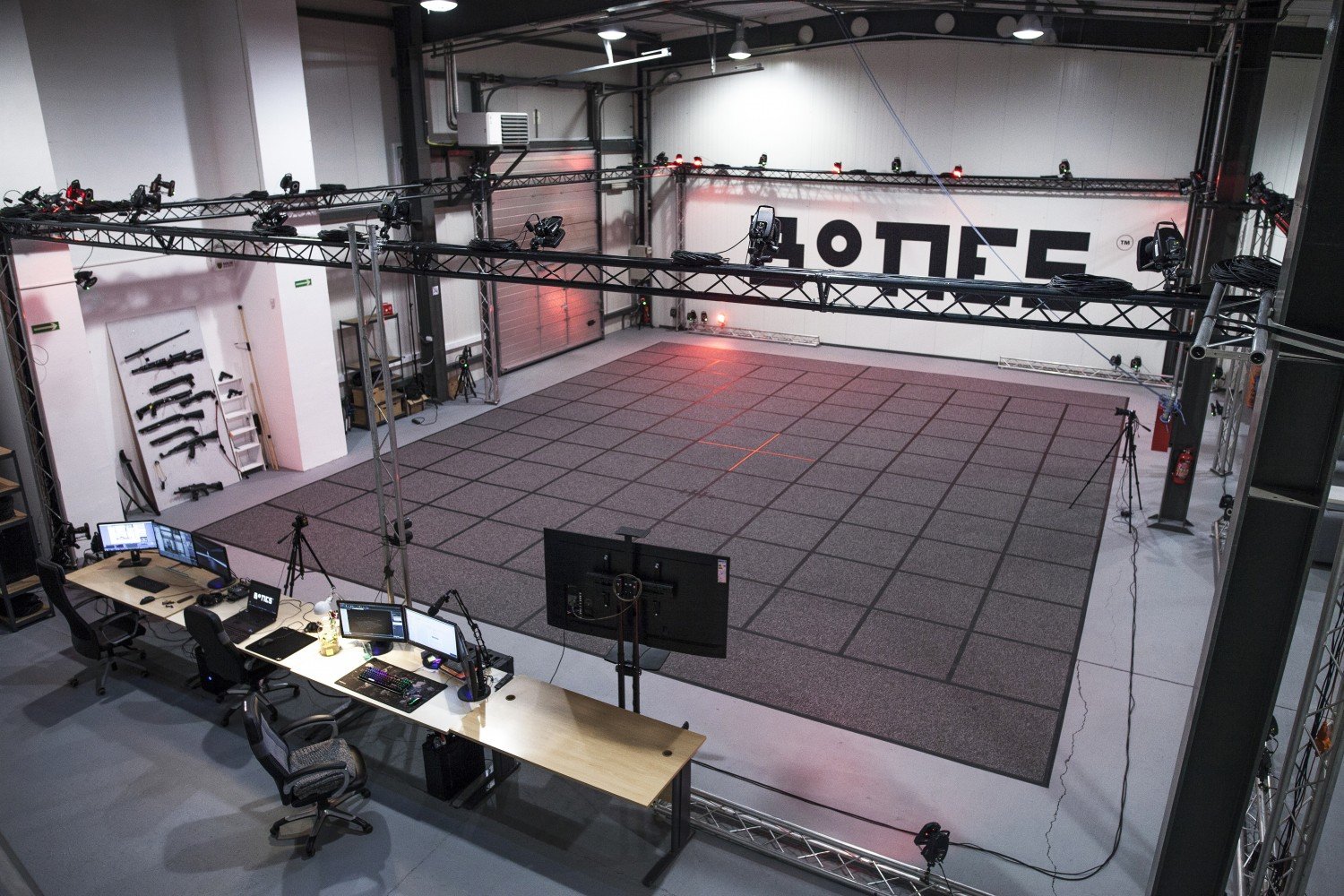

Wnętrze szablonowe bynajmniej nie jest. Pośrodku mieści się otoczona kilkudziesięcioma kamerami Vicona scena. Ktoś konsultuje cutsceny fabularyzowanej strzelanki. Ktoś rozkleja na podłodze czarną taśmę. Ktoś przynosi z kanciapy plastikowe karabiny. Ktoś inny kręci głową, że za małe.

Na planie zjawia się Maciej Kwiatkowski, bodaj najbardziej doświadczony performer mocapowy w Polsce. Z Perdjonem znają się od „Wiedźmina”, będzie z 15 lat, później Kwiatkowski grał i koordynował zresztą kaskaderkę trylogii (oraz wymyślał choreografię jej starć). „Co właściwie trzeba podczas takiej sesji nagrać?” – pytam go prostolinijnie.

„Gameplay, czyli musimy stworzyć serię krótszych i dłuższych animacji, które posłużą jako chód, bieg lub walka. To 4–8 sekundowe pętle ruchów, które gracz będzie obserwował przez całą grę, ich timing jest więc kluczowy” – tłumaczy.

„Później idle – dodaje Kwiatkowski – a więc ruchy, które wykonujemy, gdy nasza postać nie zajmuje się niczym konkretnym. A ponieważ bohaterowie niezależni są zazwyczaj widoczni w szerokim kadrze, na oddalonej kamerze – aktor musi odpowiednio „przerysować” ich oddychanie, przestępowanie z nogi na nogę, rozglądanie się czy palenie papierosa. Każdy gest musi być za duży, za szeroki, karykaturalnie wyrazisty”.

Następne w kolejności są cutsceny. „Zupełnie inaczej rejestruje się przerywniki filmowe, podczas których pracujemy «pod kamerę», na wąskim ujęciu. To zresztą najciekawsze sesje mocapowe, najbliższe doświadczeniu filmowemu” – wyjaśnia Kwiatkowski.

„Nazywamy się Bones Studio – tłumaczy Perdjon – bo kluczowy dla animacji 3D jest szkielet postaci”. Gdy mówi, dwa oddziały wymieniają na scenie ostrzał. Zamiast munduru każdy z „żołnierzy” włożył obcisły kostium z 50 markerami, które przytroczono do kluczowych punktów kości i stawów.

Ujęcie rozpoczyna i kończy tzw. T-Pose: performer staje wówczas na baczność i wyciąga ręce wzdłuż siebie, rzeczywiście upodabniając się do literki T. Znaczniki są w takiej pozie doskonale widoczne dla kamer. Te nie rejestrują obrazu, ale trajektorię ruchów performera, emitując w tym celu wiązki światła podczerwonego, które odbijają się od markerów.

Popularną alternatywę stanowi tzw. mocap inercyjny, a więc zestaw: bańka elektromagnetyczna i obudowany akcelerometrami i żyroskopami „szkielet”. „Wygląda nieporęcznie, ale to przy grach bardzo pomocny system, dzięki któremu możemy realizować sceny, jakie w studiu byłyby niemożliwe (np. działania militarne «w terenie») lub potencjalnie czasochłonne. Jeśli chcielibyśmy posadzić postać w samochodzie, to albo sami możemy zbudować prop (rekwizyt – przyp. red.), albo wziąć aktora i cewkę magnetyczną do prawdziwego samochodu” – wyjaśnia Perdjon.

Do analogicznych wniosków dochodzą zresztą najwięksi z największych. Do niedawna mocap serii „FIFA” realizowano w zbudowanym w Vancouver studiu-boisku, ale od kilku lat Electronic Arts pobiera materiał bezpośrednio z murawy. Na okoliczność ubiegłorocznej edycji ruchy zawodników zarejestrowano podczas pięciu profesjonalnych treningów (powstało w ten sposób ponad 6 tys. animacji). Co nawet ważniejsze: reżyser po raz pierwszy zaprosił na sesję także reprezentantki kobiecego futbolu.

Mocap ma płeć

„Jest w «Zabójcach królów» scena, w której wiedźmin zagląda przez dziurkę od klucza do pokoju, w którym jedna z kobiet smaga drugą pejczem. Ja jestem tą smaganą” – wspomina Perdjon. „Ale z mężczyznami wcielającymi się w role kobiece (i na odwrót) jest jednak na ogół problem – wtrąca Kwiatkowski. – O ile w filmie możemy sobie pomóc make-upem, kostiumem czy ujęciem, mocapu nie oszukasz. Kobiety są od mężczyzn średnio o 30% bardziej gibkie, mają o 30% mniej masy mięśniowej i inną budowę bioder, kluczową przy poruszaniu się. O facetach, którzy potrafią «zagrać» kobiecy chód, chodzą w studiach mocapowych legendy”.

Być może „mocapu nie oszukasz”, ale własny szkielet – owszem. Założone na kostki ciężarki zupełnie zmieniają sposób, w jaki stawiamy kroki; z kolei obciążenie nadgarstków rewolucjonizuje sekwencje walki. Jeżeli aktor potrzebuje dodatkowo usztywnić kręgosłup, np. gdy jego postać porusza się w zbroi płytowej, otrzymuje on od propmastera kamizelkę obciążeniową. Zdarzają się jednak sytuacje mniej szablonowe, przykładowo na okoliczność nagrodzonej Paszportem „Polityki” poetyckiej platformówki „Bound” baletnica Maria Udod musiała w pewnym momencie przywdziać kilkukilogramowy „brzuch”, bez którego nie potrafiła wiarygodnie oddać tańca ciężarnej bohaterki.

Miecz, czyli rurka PCV

Gdy materiał trafia na biurko animatorów, ci muszą „oczyścić” dane. „Częstym problemem mocapu jest okluzja, czyli sytuacja, gdy markery nakładają się na siebie. W T-Pose kamery doskonale wszystko „widzą”, ale jeśli aktor zwinie się w kulkę i zrobi fikołek – może zdarzyć się, że znaczniki nałożą się na siebie. A my musimy takie «gapy» uzupełnić ręcznie” – wyjaśnia Perdjon. Ruchy performera nakłada się następnie na trójwymiarowy model bohatera gry i umiejscawia w lokacji. Ale także na tym etapie czają się niespodzianki.

„Mocapowałem raz scenę w «Agony» – wspomina Perdjon – której zleceniodawca zażyczył sobie, by dwie kobiety całowały się na stole, jednocześnie oblewając płynem. Aktorki nie miały z tym zleceniem problemu, ale dopytywały o szczegóły. Po wymianie kilku maili okazało się, że nasz stół zamieni się w grze w katafalk, a płyn stanie się mieszaniną krwi i ropy”.

Przygotowanie sceny (enviro) i rekwizytów (propów) regularnie zakrawa zresztą na prowizorkę. Skoro mocap zajmuje się wyłącznie rejestrowaniem ruchu, używane przez aktorów przedmioty nie muszą przecież przypominać swych późniejszych odpowiedników. Wystarczy przylepić do rurki PCV kilka markerów taśmą izolacyjną, by ta zamieniła się w miecz. Mop może bez trudu stać się włócznią, sklejony z deską przedłużacz – piłą tarczową, a zwinięty kawałek linoleum – shotgunem, minigunem i/lub bazooką.

„Kiedyś zrobiliśmy nawet F-16” – zdradza mi nadzorująca sesje Agnieszka Podlewska. Jak się robi F-16? „Budujesz elementy styku, punkty, w których aktor musi nawiązać z obiektem interakcję, czyli w naszym wypadku: drabinkę, siedzisko, kierownicę. Szkielet reszty zbudowaliśmy z jakiegoś starego rusztowania”. Marcin Panek, szef technologii w Bones Studio, dopowiada: „Mój ulubiony prop to był gramofon. W cutscenie gry postać wkładała do niego winyl, który zaczynał się kręcić. U nas aktor robił niby to samo, ale i adapter, i płytę wycięliśmy z kartonu”.

Perdjon z rozrzewnieniem wspomina, jak oszukiwał oczy graczy „Dzikiego gonu”. Ci nie wychwycili na przykład, że w jednej ze scen seksu Yennefer zastąpił dwudziestolitrowy baniak z wodą. Powód? Prozaiczny: choreografia była tak wymyślna, że przy dwójce aktorów kamery „gubiły” znaczniki ruchu (a w efekcie na czole czarodziejki lądował wiedźmiński łokieć). Gdy zaś para uprawia miłość na grzbiecie jednorożca – w mityczne zwierzę „wcielają się” nałożone na siebie palety styropianu (o rolę ubiegał się także stół, który jednak pękł podczas zdjęć próbnych).

Kaczor Donald kontra motion capture

„Dyplomowałem u Stuhra, ale zawsze chciałem robić «Zwariowane melodie» – wspomina zawodowe początki Perdjon. – Paręnaście lat temu wyjechałem do Frankfurtu na sesję mocapową. Założyli na mnie kostium, okleili kulkami… I nagle zobaczyłem na ścianie szkielet, który porusza się tak jak ja! Jak się dowiedziałem, że dałoby się na taki szkielet „nadziać” Królika Bugsa, to zupełnie zwariowałem!”

To jednak (o ironio) kreskówki stawiają motion capture największy opór. Gdy pytam, czego studio nie byłoby w stanie nagrać, Panek natychmiast wypala: „«Kaczora Donalda». Szczególnie sekwencji przebierania nogami, gdy dopiero «rozgrzewa się» on do biegu”. Przy kręceniu klasycznych animacji mocap pozostaje w zasadzie bezużyteczny – na przeszkodzie stają ciągłe zmiany proporcji i nienaturalne wygięcia ciał animków. Żaden aktor nie „zagra” przecież Kojota Wilusia, gdy ten spada ze zbocza i rozpłaszcza się na naleśnik.

Pozostałe granice specjaliści od mocapu sukcesywnie forsują. Pytany o powód, dla którego obie części „Avatara” dzieli 13 lat, reżyser James Cameron wskazywał m.in. na poprzedzenie zdjęć kilkuletnią pracą nad rozwojem motion capture. Estetycznym twistem sequela jest przecież umiejscowienie akcji w głębinach Pandory, tymczasem w 2009 roku mocap nie radził sobie jeszcze z rejestrowaniem aktorów pod wodą. Trudno o lepszy dowód na to, że globalna popkultura nie rusza do przodu bez dbałości o ruch.