Wyobraź sobie, że jedziesz samochodem, powiedzmy z Krakowa do Gdyni. Suniesz gierkówką, minęłaś już Częstochowę i z niecierpliwością wypatrujesz miejsca, gdzie zaczyna się autostrada, która doprowadzi cię prosto nad morze. Co tam autostrada, gierkówka to praktycznie droga ekspresowa, więc pędzisz te 140 km/h. Widzisz przed sobą, jeszcze w sporej odległości, światła z przejściem dla pieszych, ale masz nadzieję wyprzedzić jeszcze to seicento, które wlecze się przed tobą, więc nie zaczynasz zwalniać. Światła się zbliżają, załapiesz się na czerwone. Powoli naciskasz stopą hamulec. Naciskasz go mocniej, jeszcze mocniej, do dechy – i nic. Momentalnie pot występuje ci na czole. Dostrzegasz przed sobą ludzkie postaci. Jeszcze parę razy próbujesz nacisnąć ten cholerny hamulec, ale już wiesz, że nic z tego, przestał działać. Próbujesz redukować biegi, ale odległość pomiędzy tobą a pieszymi na pasach zmniejsza się nieubłaganie. Musisz ich ominąć, licząc na łut szczęścia, że nikomu nic się nie stanie, a ty nie zostaniesz staranowana przez auta wyjeżdżające z drogi poprzecznej. Musisz, ale wiesz już, że i to się nie uda, całe pasy są zajęte: do wysepki powoli dociera siwa babunia ciągnąca za sobą wózek z zakupami, na środku dwóch nastolatków wpatrzonych w smartfony – pewnie szukają pokemonów albo umawiają się na wieczór – leniwie ciągnie nogę za nogą, a z prawej strony z krawężnika zeskakuje troje słodkich dzieciaczków: dwie większe dziewczynki – na oko jakieś 5–6 lat – i ich młodszy braciszek, prowadzony za rękę, za nimi podąża ich młoda mama. Co masz zrobić? Którędy przejechać? Dociera do ciebie, że to sytuacja bez wyjścia, że nie dojedziesz dziś do Gdyni i że całe twoje życie wywróci się do góry nogami. Zabijesz człowieka. Przejedziesz go swoim nowym samochodem, którym cieszysz się dopiero od pół roku. Ale kogo, kogo przejedziesz? Kogo poświęcisz? Babunię – bo już niewiele lat przed nią? Czy tych chłopców, wyglądających trochę podejrzanie? Bo na pewno nie dzieci, prawda? Na pewno nie dzieci. Ale właściwie czemu nie? A teraz wyobraź sobie, że jesteś komputerem pokładowym. Za kierownicą nikt nie siedzi, a ten pot na czole to tylko przegrzewający się procesor.

Choć prace nad autonomicznymi pojazdami toczą się już od dawna – właściwie niemal od stu lat – to dopiero niedawno w powszechnej wyobraźni przeszły ze sfery science fiction do szufladki pod nazwą „co chciałabym dostać w przyszłym roku na Gwiazdkę”. Praktycznie każda większa firma motoryzacyjna testuje już modele, które lepiej lub gorzej radzą sobie w normalnym ruchu miejskim. Najwięcej oczywiście mówi się o projektach realizowanych przez najgorętsze firmy technologiczne: Google, Teslę, a od niedawna Apple. Gdy Elon Musk, prezes Tesli, ogłosił w marcu tego roku szczegóły nowego modelu – nazwanego skromnie Tesla Model 3 – który ma ujrzeć światło dzienne najwcześniej za rok, w ciągu tygodnia ponad 300 tys. osób na całym świecie wpłaciło po tysiąc dolarów zaliczki, żeby zarezerwować sobie miejsce w kolejce.

Tesla potrafi wywoływać wokół siebie szum. W październiku ubiegłego roku świat obiegła wiadomość, że właściciele tesli S wyprodukowanych po 2014 roku (starsze się nie załapały) otrzymali w nocy aktualizację oprogramowania, która w ich maszynach zainstalowała autopilota. Potrafi on nie tylko wyznaczyć trasę z punktu A do punktu B, zahamować przed przeszkodą czy zaparkować w ciasnym miejscu, ale również rozpoznawać znaki drogowe i samodzielnie zmienić pas. Choć autopilot, przynajmniej oficjalnie, ma tylko służyć pomocą, a prowadzący powinien nieustannie trzymać ręce na kierownicy i kontrolować sytuację, to doniesienia kierowców wskazują, że lekce sobie oni ważą te przestrogi i z fascynacją ośmiolatka testują granice technologii.

Nie trzeba było długo czekać, żeby doprowadziło to do tragedii. Na początku lipca na Florydzie Joshua Brown, 40-letni były komandos Navy SEAL, stracił życie po tym, jak jego tesla S wjechała w tira. Samochód był sterowany przez autopilota, a niektórzy świadkowie twierdzili – choć policja nie potwierdza tej wersji ze względu na niekonkluzywne doniesienia – że widzieli, jak kierowca w trakcie jazdy oglądał film.

Wypadki przydarzyły się też całkiem niedawno samochodom Google. W lutym w Kalifornii doszło do niewielkiego wypadku, który odbił się szerokim echem w mediach, ponieważ był pierwszą stłuczką spowodowaną przez samą maszynę, a nie przez ludzkich kierowców innych pojazdów (podobno najczęściej wjeżdżają oni w tylny zderzak samochodów Google, kiedy te hamują przed znakiem STOP). Ciekawe było wyjaśnienie, które opublikowała firma. Do wypadku doszło po tym, jak autonomiczny samochód wykrył przed sobą blokadę pasa i usiłował zjechać na drugi – po przepuszczeniu kilku pojazdów, z niewielką prędkością zaczął ruszać i choć zarejestrował zbliżający się z tyłu autobus, założył, że ten go przepuści. Nie przepuścił. „Do tego rodzaju nieporozumień na drodze dochodzi między ludzkimi kierowcami każdego dnia” – głosił komunikat. I trudno nie przyznać mu racji.

O wypadkach autonomicznych samochodów słychać coraz częściej głównie dlatego, że w niektórych stanach USA dopuszczono je do ruchu ulicznego. Oczywiście, zawsze musi w nich siedzieć człowiek, prędkości są limitowane, ale dla mieszkańców Kalifornii, Michigan, Tennesse czy Hawajów spotkania z kierowcami, na których nie podziała sążniste słowo rzucone przez okno, stają się codziennością. Roboty wyjeżdżają na ulice i nic ich nie powstrzyma.

Jak dobrze pokazuje wypadek z Kalifornii, błędy maszyn nie zawsze są powodowane niedostatkami technicznymi. Samochód Google dostrzegł autobus, ale błędnie założył, że jego kierowca ustąpi pierwszeństwa. To nie była kwestia ustalenia sytuacji, ale jej oceny. Innymi słowy, nie technologia tu zawiodła, ale etyka. Nic więc dziwnego, że zjawiskiem autonomicznych pojazdów – zresztą nie tylko pojazdów, ale też dronów, robotów domowych czy maszyn wykorzystywanych na wojnie – zinteresowali się naukowcy, usiłujący ustalić, w jaki sposób można przełożyć ludzkie kategorie wartościujące na język zrozumiały dla komputerów. I nie chodzi tu o znane z książek i filmów science fiction trzy prawa robotyki Isaaca Asimova, mające uchronić ludzkość przed zagładą. Współczesna etyka maszyn – dziedzina rozwijająca się intensywnie od początku XXI wieku – interesuje się bardziej przyziemnymi kwestiami związanymi z codziennością. Jak wytłumaczyć maszynie, że przepuszczanie kobiet w ciąży na pasach, choć nie jest wymagane prawem, bywa zwyczajnie uprzejme? I jak można zaprogramować autonomiczny samochód, żeby nigdy, ale to nigdy nie poganiał elki z żółtą naklejką „EGZAMIN”?

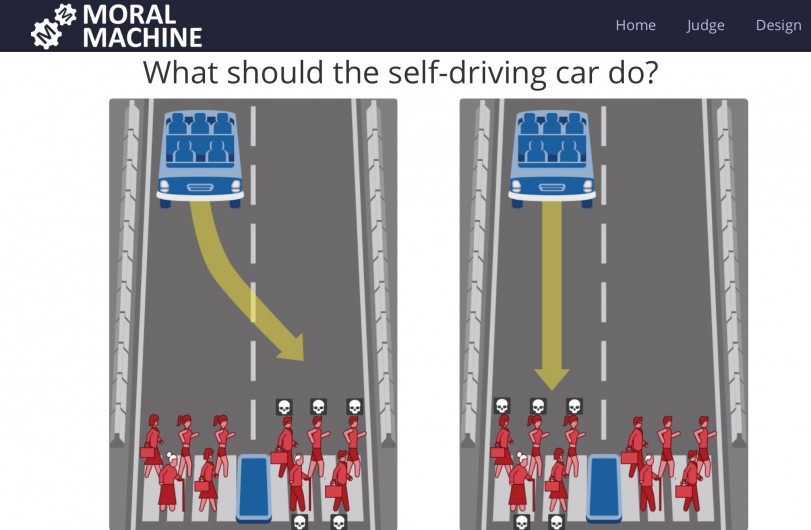

Naukowcy z MIT opublikowali niedawno prostą aplikację, która ma pozwolić na zebranie i analizę sporych danych ilościowych dotyczących ludzkich decyzji etycznych. „Moral Machine” prezentuje użytkownikom prosty quiz składający się z 13 plansz przedstawiających trudne do rozstrzygnięcia sytuacje drogowe z udziałem autonomicznego pojazdu, któremu popsuły się hamulce. Albo rozjedzie mężczyznę, który przechodzi przez pasy na czerwonym świetle, albo wjedzie w betonową barierkę i doprowadzi do śmierci trojga swoich pasażerów. Bywa jeszcze trudniej: czy lepiej przejechać starszą panią na czerwonym świetle czy złodzieja uciekającego z łupem na zielonym? czy lepiej mężczyznę z brzuszkiem, czy wysportowaną kobietę? czy lepiej jedno dziecko, czy trzy psy i dwa koty?

Po wypełnieniu ankiety otrzymujemy podsumowanie podjętych decyzji, porównujące nasze preferencje z przeciętnymi wartościami dotychczas zgromadzonych wyników. Po pierwszym wypełnieniu ankiety wyniki mogą okazać się zaskakujące – mnie przynajmniej zaskoczyły – bo ujawniają wszystkie czynniki, które przedstawione były na obrazkach, a które na pierwszy rzut oka zdawały się bez znaczenia: kolor światła na przejściu, kształt sylwetki, społeczną użyteczność pieszego.

Na stronie można też podyskutować na temat każdej z sytuacji, wyjaśnić swój proces decyzyjny i skonfrontować go z odmiennymi punktami widzenia. Można również zaprojektować własną sytuację drogową, jeszcze bardziej komplikując wcześniejsze warianty.

„Moral Machine” przypomina szalejący niedawno na Facebooku „Trolley dilemma”, czyli dylemat wagonika – problem etyczny wymyślony w 1967 roku przez Philippę Foot, a polegający w największym skrócie na konieczności wyboru mniejszego zła: czy pozwolić, by pociąg przejechał pięć osób, czy przestawić zwrotnicę i poświęcić tylko jedną. Eksplozja publikowanych w internecie wariacji komplikujących ten stosunkowo prosty dylemat pokazuje, że ludzka wyobraźnia sama siebie potrafi doprowadzić do absolutnej rozpaczy. A jak miałby sobie poradzić z tym prosty komputer, przyzwyczajony do zero-jedynkowej rzeczywistości?

Zbliżasz się do pasów, wszystkimi swoimi kamerami dostrzegasz, że z tej sytuacji nie ma dobrego wyjścia. Co robić, co robić? Jesteś na to za mała. Kernel panic, fatal error – zamykasz oczy. Niech się dzieje. Mija chwila trwająca całą wieczność, rebootujesz się do życia i oglądasz za siebie. Dwaj chłopcy trzymają babunię pod ręce, stojąc bezpiecznie na wysepce i wygrażając ci pięściami. Klęcząc przy krawężniku, matka ogarnia swoją niesforną trójkę, chłopiec płacze, dziewczynki wyglądają na przerażone. Na środku pasów leży zniszczony wózek na zakupy, pomarańcze suną wolno przez skrzyżowanie. Kamień spada ci z RAM-u, redukujesz powoli biegi, musisz odpocząć. Nawet się cieszysz, że jadąca za tobą czarna insignia włącza niebieskie światła. A mogliby już tę gierkówkę przerobić na autostradę!

Tekst dostępny na licencji Creative Commons BY-NC-ND 3.0 PL (Uznanie autorstwa-Użycie niekomercyjne-Bez utworów zależnych).